超强写作 AI 竟然学会象棋和作曲,语言模型跨界操作引热议,在线求战

本文经 AI 新媒体量子位(公众号 ID:QbitAI)授权转载,转载请联系出处。

一个搞文本生成的模型,还能用来干嘛?

好奇心很强的网友便拿 OpenAI 的GPT-2做了个实验。

原来,GPT-2 除了能生成文本,竟然还能下象棋、做音乐!

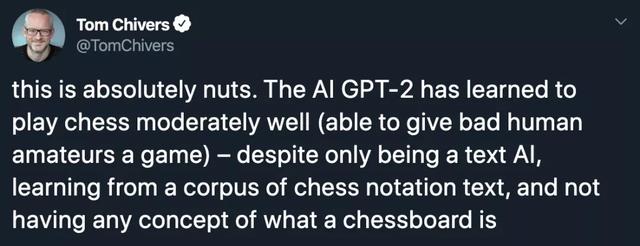

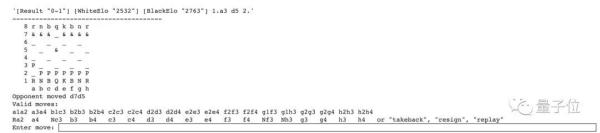

△训练 GPT-2 下国际象棋

作者表示:

事实证明,只要让 GPT-2 预测下一步棋,就可以训练它下国际象棋。

这只是花费了几天的小项目,但结果是相当令人兴奋。

除此之外,在更早的实验中,研究人员还发现 GPT-2 能作曲。

这也引起了网友们的热烈讨论。

这简直太疯狂了,和玩得较差的人类尚可一搏。

GPT-2 学会了下国际象棋,尽管它只是一种文本 AI,但是还是能够从象棋符号文本的语料库中学习。

而且它对“棋盘”的概念一无所知。

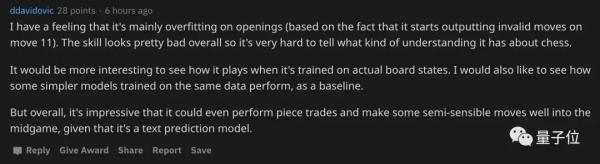

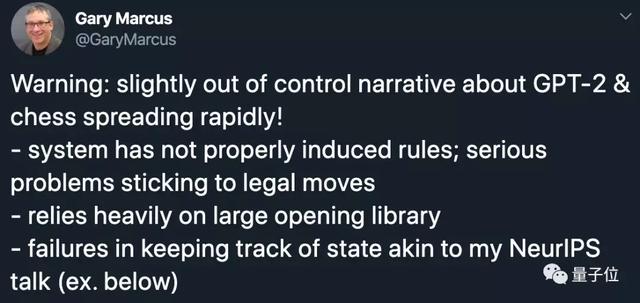

不过,也有网友对此提出了质疑。

我有一种感觉,它只是在开局的较为配合,从第 11 步开始就输出无效的“招式”了。

总的来说,这个技术看起来很糟糕,所以很难判断它对国际象棋有什么样的理解。

不过作为一个文本预测模型,在这样的游戏中能做出一些智能的举动,还是令人印象深刻的。

那么,GPT-2 下国际象棋、做音乐,到底是怎么一回事呢?

下象棋、做音乐,GPT-2 成跨界选手

用 GPT-2 来下象棋,最开始大概只是一个娱乐项目。作者肖恩·普莱斯(Shawn Presser)只用了一周的时间就完成了 Demo。

之所以做出这样大胆的尝试,是因为他的胖友格温·布兰文(Gwern Branwen)不仅教会了 GPT-2 写诗:

美丽的湖,美丽的树林,(Fair is the lake, and bright the wood,)

垂满魅惑的花朵:(With many a flower-full glamour hung:)

美丽的浅滩,温柔的潮水(Fair are the banks; and soft the flood)

我们的舌头发出金色的欢笑。(With golden laughter of our tongue.)

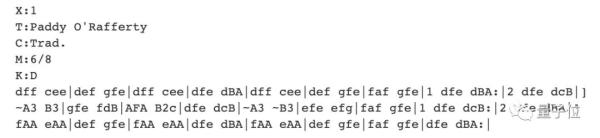

还让 GPT-2 写出了爱尔兰民歌:

音乐 _2.mp3

00:50.058

来自量子位

乍一听这个开头,甚至有点像孙燕姿的《遇见》。

实际上,布兰文是用 Session & ABCnotation.com 上的 20 多万首音乐作品对 GPT-2 模型进行了训练,这些作品将乐曲以字母文本的形式体现。

所以,能不能通过 e2e4(将棋子从 e2 位置移动到 e4 位置)这样的国际象棋指令集来训练 GPT-2,让这个文本生成模型学会下棋呢?

答案是:可以。

普莱斯发现,仅仅经过一个小时的训练,GPT-2 1.5B 模型就表现出了国际象棋“天赋”。

虽然在下了几步棋之后,就会出现无效移动,但这次实验还是证明了,制造 GPT-2 国际象棋引擎并非不可能。

△第 9 步出现无效移动

于是,普莱斯又用 2.4M 数据训练了 GPT-2 1.5B 模型一整天,模型有所进步:直到第 14 步,它才出现了 bug。

接着,普莱斯“编写了一些代码以计算所有有效移动的概率”(作者并未作出具体解释),GPT-2 可以将棋局推至残局了。

普莱斯已经把他的代码部署到了 Colab 上,如果你想试试这只会下棋的 GPT-2 棋商如何,可以亲身前往挑战:

逆天的语言 AI—GPT-2

去年 2 月,OpenAI 发布了一个 **“逆天”的语言 AI**,名为 GPT-2。

整个模型包含15 亿个参数。

这个 AI 写起文章来文思泉涌毫无违和感,无需针对性训练就能横扫各种特定领域的语言建模任务,还具备阅读理解、问答、生成文章摘要、翻译等等能力。

然而,当时假新闻实在编的太真实,所以 OpenAI 说:我们不敢放出完整模型。

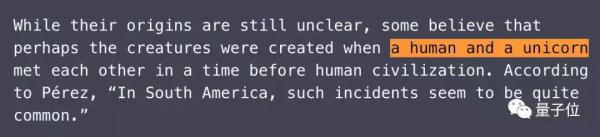

人类只给了它两句话的开头:

科学家们有个令人震惊的发现,在安第斯山脉一个偏远且没被开发过的山谷里,生活着一群独角兽。更加让人讶异的是,这些独角兽说着完美的英文。

AI 就顺着这胡言乱语的设定,一本正经地编了下去:

这些生物有着独特的角,科学家们就以此为它们命名,叫 Ovid’s Unicorn。长着四只角的银白色生物,在这之前并不为科学界所知。

虽然,这些生物的起源还不清楚,但有些人相信,它们是一个人和一个独角兽相交而诞生的,那时人类文明还不存在。Pérez 教授说:“在南美洲,这样的现象很常见。”

效果惊人外,在各种特定领域数据集的语言建模测试中,GPT-2 都取得了优异的分数。

网友们对其完全开源的呼声越发强烈,于是在接下来的时间里,GPT-2 经历了 **“挤牙膏式的开源”**。

它初出茅庐时先放出了 124M 版本的模型,然后是 355M,再然后是 774M。

经过 9 个月断断续续发布,OpenAI 最终把 15 亿参数的完整模型放了出来。

实测结果如何?

OpenAI 在博客里说,GPT-2 的生成结果,有独立客观第三方的检验,令人信服:

团队在康奈尔大学的合作伙伴,对人类做了问卷调查,给 GPT-2 输出的文本打出可信分 (Credibility Score) ,各种大小的模型都参与了。

满分 10 分,大家给 15 亿参数模型的可信分是 6.91。比 7.74 亿参数的模型 (6.72 分) 和 3.55 亿参数的模型 (6.07 分) 都要高。

也就是说在人类眼里,15 亿参数模型,比之前放出的那些模型,写出的文章更逼真了。

语言模型跨界引热议

超会编故事的 NLP 模型,现在还能写曲子、下象棋了,这件事引发了网友的热议,甚至吸引来了马库斯。

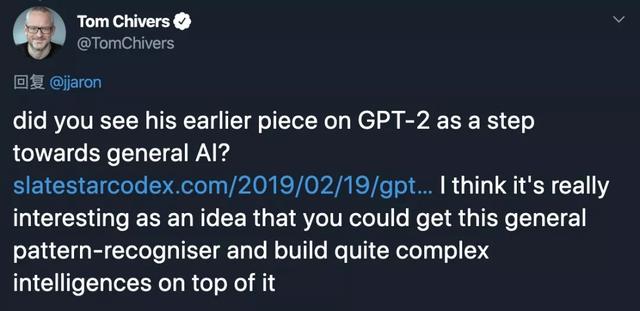

英国作家 Tom Chivers 认为,这或许将打开通向 AGI(通用人工智能)的新思路。

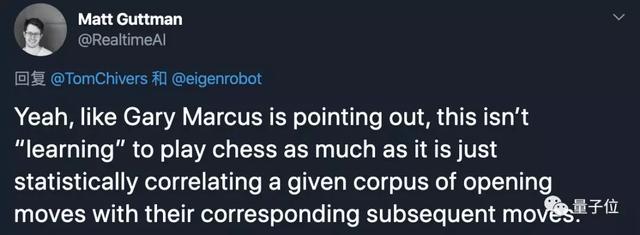

有网友质疑说,这并不是对下棋这件事的“学习”,只是在统计学上将给定的开局动作与其相应的后续动作关联起来。GPT-2 仅仅是给出了符合已知模式的结果。

一位斯坦福 CS 博士则直言,可能使用非常古早的语言建模方法同样能实现这一结果。说 GPT-2“学会下棋”是一种误导。

那么,你怎么看呢?

作者介绍

△Shawn Presser

Shawn Presser,具有丰富的 C++ 游戏引擎编程经验,是一位图形学编程人员、工具开发者。

2010 年至 2011 年,就职于 S2 Games,参与 Heroes of Newerth 游戏项目的相关工作。

2005 年至 2008 年,就职于 Simutronics,主要从事基于 C++ 的项目开发工作。

传送门

Reddit:

https://www.reddit.com/r/MachineLearning/comments/elf66h/p_using_gpt2_to_play_chess/

博客:

https://slatestarcodex.com/2020/01/06/a-very-unlikely-chess-game/